本篇内容介绍了“python scrapy框架中Request对象和Response对象怎么用”的有关知识,在实际案例的操作过程中,不少人都会遇到这样的困境,接下来就让小编带领大家学习一下如何处理这些情况吧!希望大家仔细阅读,能够学有所成!

一、Request对象

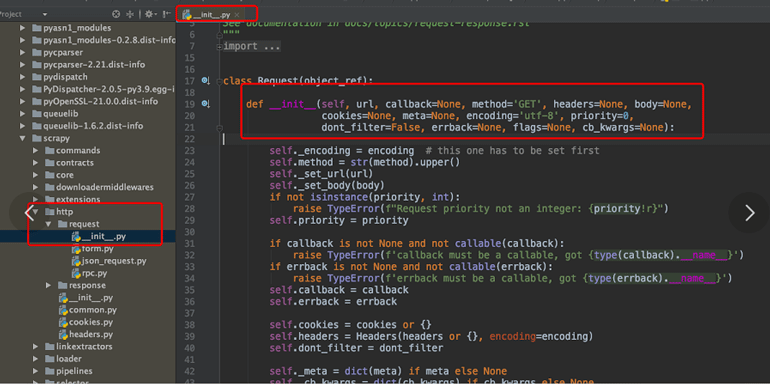

Request对象主要是用来请求数据,爬取一页的数据重新发送一个请求的时候调用,其源码类的位置如

下图所示:

这里给出其的源码,该方法有很多参数:

class Request(object_ref): def __init__(self, url, callback=None, method='GET', headers=None, body=None, cookies=None, meta=None, encoding='utf-8', priority=0, dont_filter=False, errback=None, flags=None, cb_kwargs=None): self._encoding = encoding # this one has to be set first self.method = str(method).upper() self._set_url(url) self._set_body(body) if not isinstance(priority, int): raise TypeError(f"Request priority not an integer: {priority!r}") self.priority = priority if callback is not None and not callable(callback): raise TypeError(f'callback must be a callable, got {type(callback).__name__}') if errback is not None and not callable(errback): raise TypeError(f'errback must be a callable, got {type(errback).__name__}') self.callback = callback self.errback = errback self.cookies = cookies or {} self.headers = Headers(headers or {}, encoding=encoding) self.dont_filter = dont_filter self._meta = dict(meta) if meta else None self._cb_kwargs = dict(cb_kwargs) if cb_kwargs else None self.flags = [] if flags is None else list(flags)这里对各个做一个简单的解释:

url:这个request对象发送请求的url。callback: 在下载器下载相应的数据后执行的回调函数。method:请求的方法,默认为GET方法,可以设置为其他方法。headers:请求头,对于一些固定的设置,放在settings.py中指定就可以了, 对于那些非固定的,可以在发送请求的时候指定。body:请求体,传入的是请求参数。meta:比较常用。用于在不同的请求之间传递数据用。encoding:编码。默认为utf-8,使用默认的就可以了。dont_filter: 表示不由调度器过滤,在执行多次重复的请求的时候用得比较多。errback:在发生错误的是有执行的函数。

二、发送POST请求

有时候我们想要在请求数据的时候发送post请求,那么这时候需要使用Request的子类FormRequest来实现。如果想要在爬虫一开始就发送POST请求,那么需要在爬虫类中重写start_requests(self) 方法,并且不在调用 start_urls 里的url。

三、Response对象

Response对象一般是由scrapy给你自动构建的,因此开发者不需要关心如何创建Response对象。而是如何使用它。Response对象有很多属性,可以用来提取数据的。

主要有以下属性:

meta: 从其他请求传过来的meta属性,可以用来保持多个请求之间的数据连接。encoding: 返回字符串编码和解码的格式。text: 将返回来的数据作为unicode字符串返回body: 将返回来的数据作为bytes 字符串返回。xpath:xpath选择器css: css选择器。

“python scrapy框架中Request对象和Response对象怎么用”的内容就介绍到这里了,感谢大家的阅读。如果想了解更多行业相关的知识可以关注编程网网站,小编将为大家输出更多高质量的实用文章!