Mac安装Stable Diffusion教程

电脑:MacBook Pro 14

芯片:M1Pro

内存:32GB

如果您是Mac用户,想要安装并使用Stable Diffusion进行图像生成,以下是详细的安装步骤:

重要注意事项

目前,Web UI中的大多数功能都可以在macOS上正常工作,最明显的例外是CLIP询问器和培训。虽然训练似乎确实有效,但它非常慢,并消耗了过多的内存。可以使用CLIP查询器,但它不能与macOS使用的GPU加速正常工作,因此默认配置将完全通过CPU运行(速度很慢)。

众所周知,大多数采样器在使用稳定扩散2.0模型时,唯一的例外是PLMS采样器。在macOS上使用GPU加速生成的图像通常应匹配或几乎匹配具有相同设置和种子的CPU上生成的图像。

安装所需文件已整理安装地址

- AI项目地址:微信公众号:一颗星宇宙,发送“获取SD项目”获取哦

- 开源公众号GPT项目,点我下载

自动安装

新安装:

- 如果未安装Homebrew,请按照https://brew.sh上的说明进行安装。保持终端窗口打开,并按照“后续步骤”下的说明将Homebrew添加到您的PATH中。

- 打开一个新的终端窗口并运行

brew install cmake protobuf rust python@3.10 git wget

也可以单个进行安装:brew install cmake

可以使用以下命令来查看这六个软件包的版本:

cmake: `cmake --version`protobuf: `protoc --version`rust:` rustc --version`python@3.10:` python3.10 --version`git:` git --version`wget: `wget --version`注意:这些命令需要在终端中运行。- 通过运行克隆Web UI存储库

git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui

如果GitHub无法访问https://gitee.com/wy521a/stable-diffusion-webui,我将代码放入个人的Gitee上了 - 将您想要使用的稳定扩散模型/检查点放入

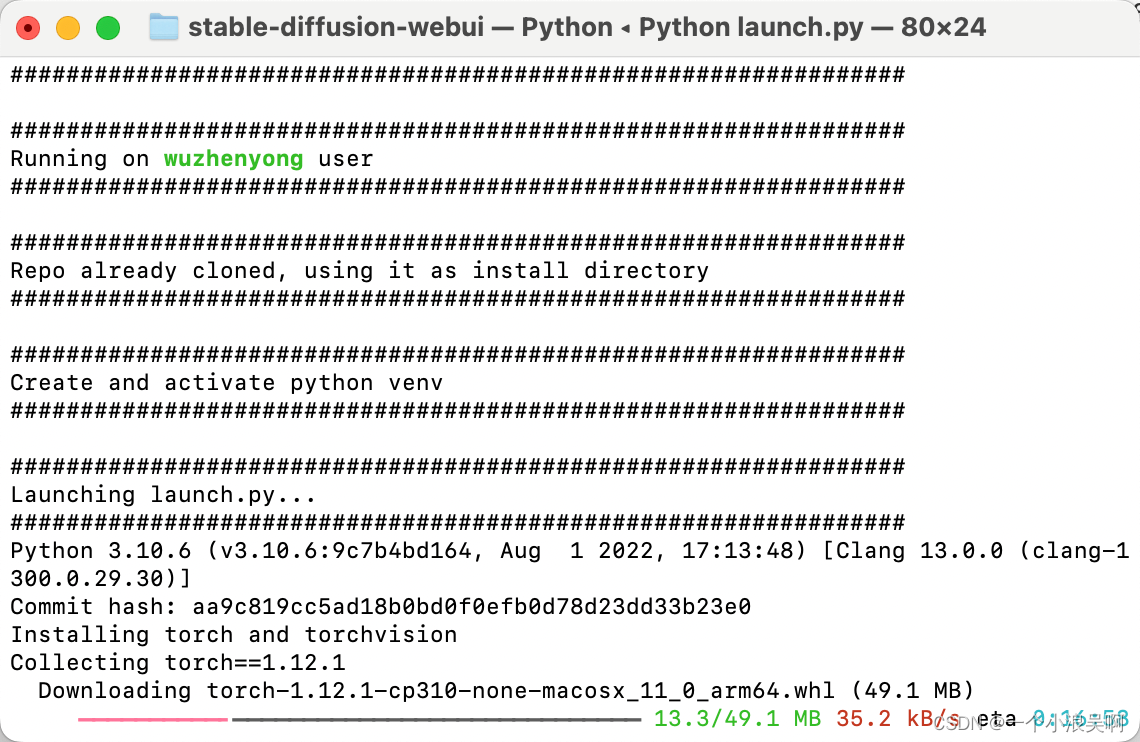

stable-diffusion-webui/models/Stable-diffusion。如果您没有,请参阅下面的下载稳定扩散模型。 cd stable-diffusion-webui然后./webui.sh运行Web UI。将使用venv创建和激活Python虚拟环境,任何剩余的缺失依赖项将自动下载并安装。- 要稍后重新启动Web UI进程,请再次运行

./webui.sh。请注意,它不会自动更新Web UI;要更新,请在运行./webui.sh之前运行git pull。

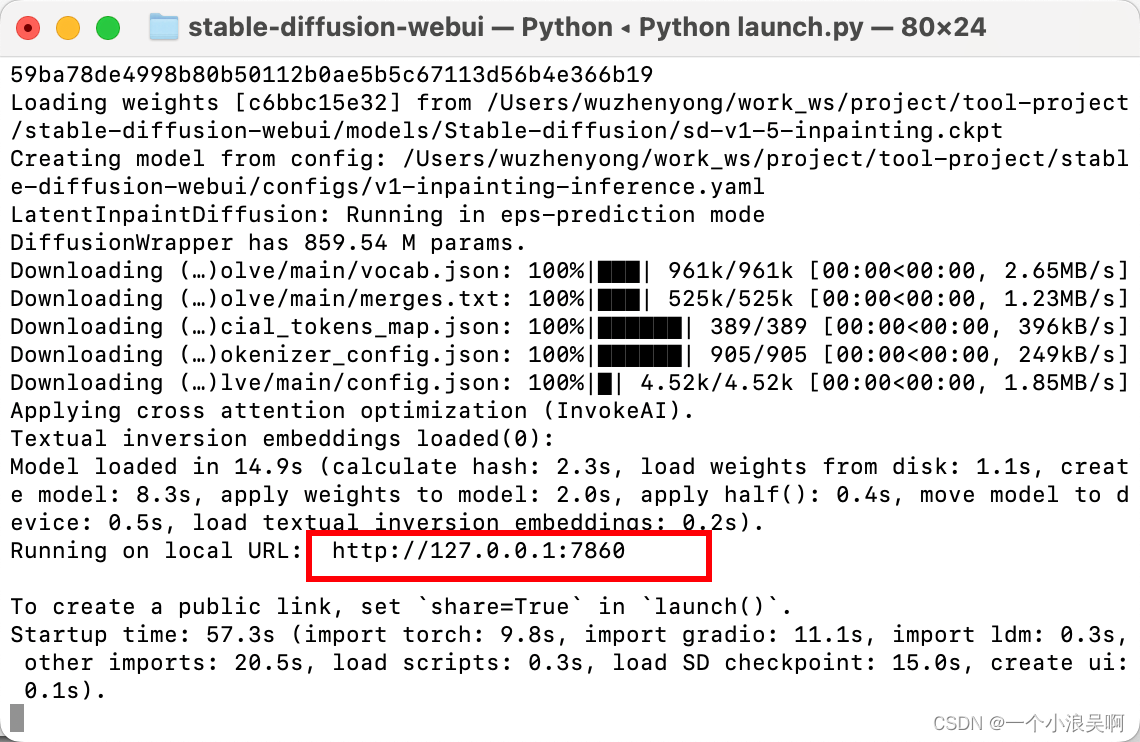

- 运行后等待下载相关的依赖

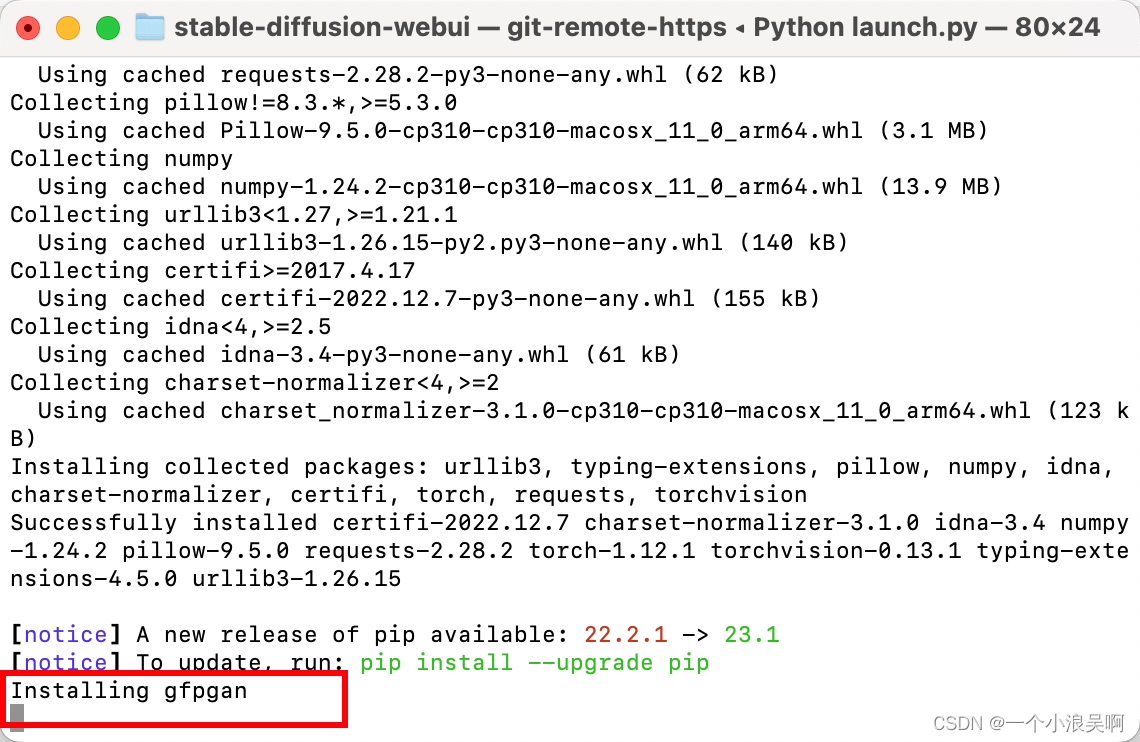

- 如果出现安装gfpgan很久这个情况如何解决?

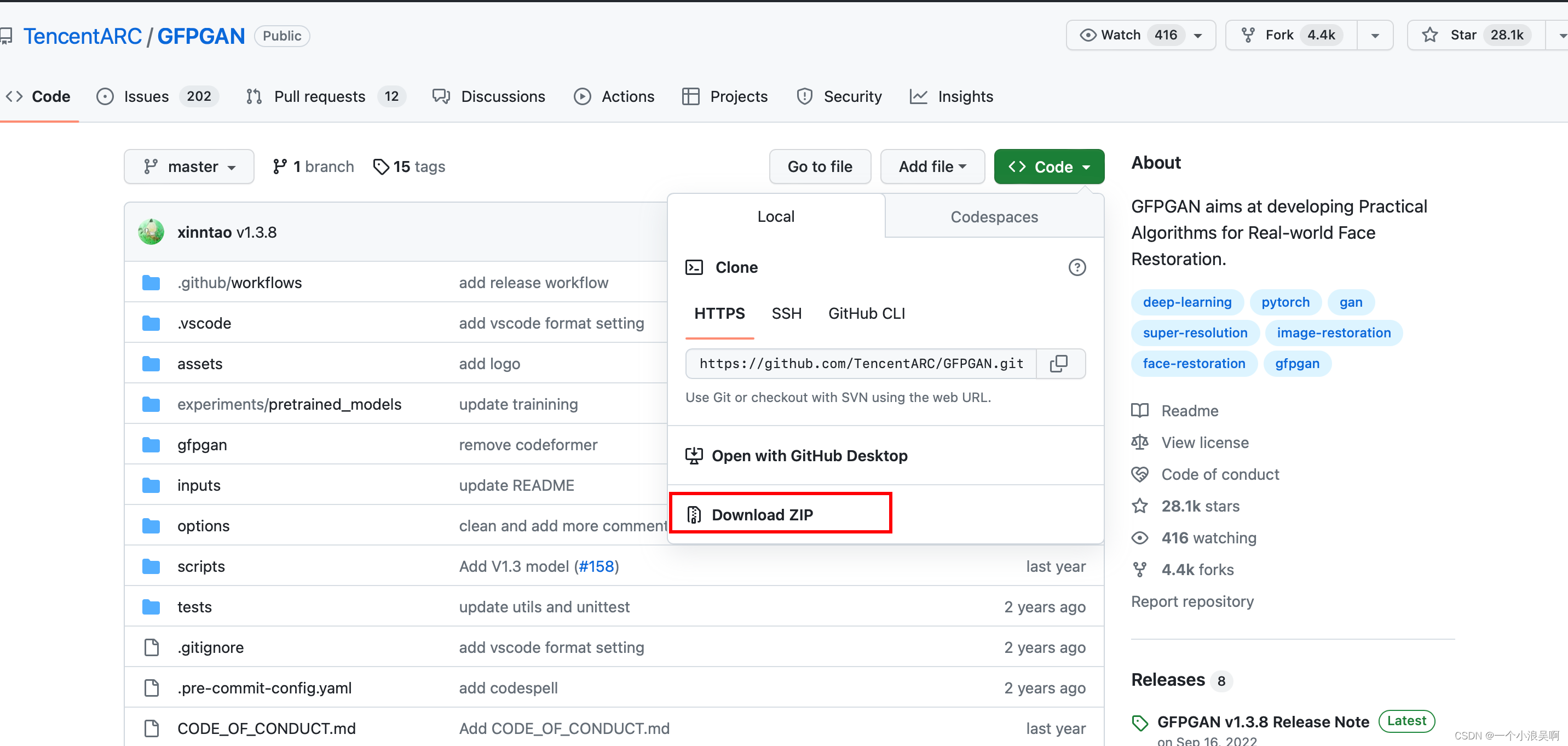

- 去gfpgan官网下载包到本地

- 在下载完解压,进入对应的项目目录下面,执行以下命令

pip install basicsrpip install facexlibpip install -r requirements.txtpython3 setup.py developpip install realesrgan如果没有pip命令则换成pip3- 执行完以上的命令重新进入我们的stable-diffusion-webui目录执行

./webui.sh命令,其他下载慢的以此类推 - 继续看执行的效果

- http://127.0.0.1:7860就是我们的访问地址啦

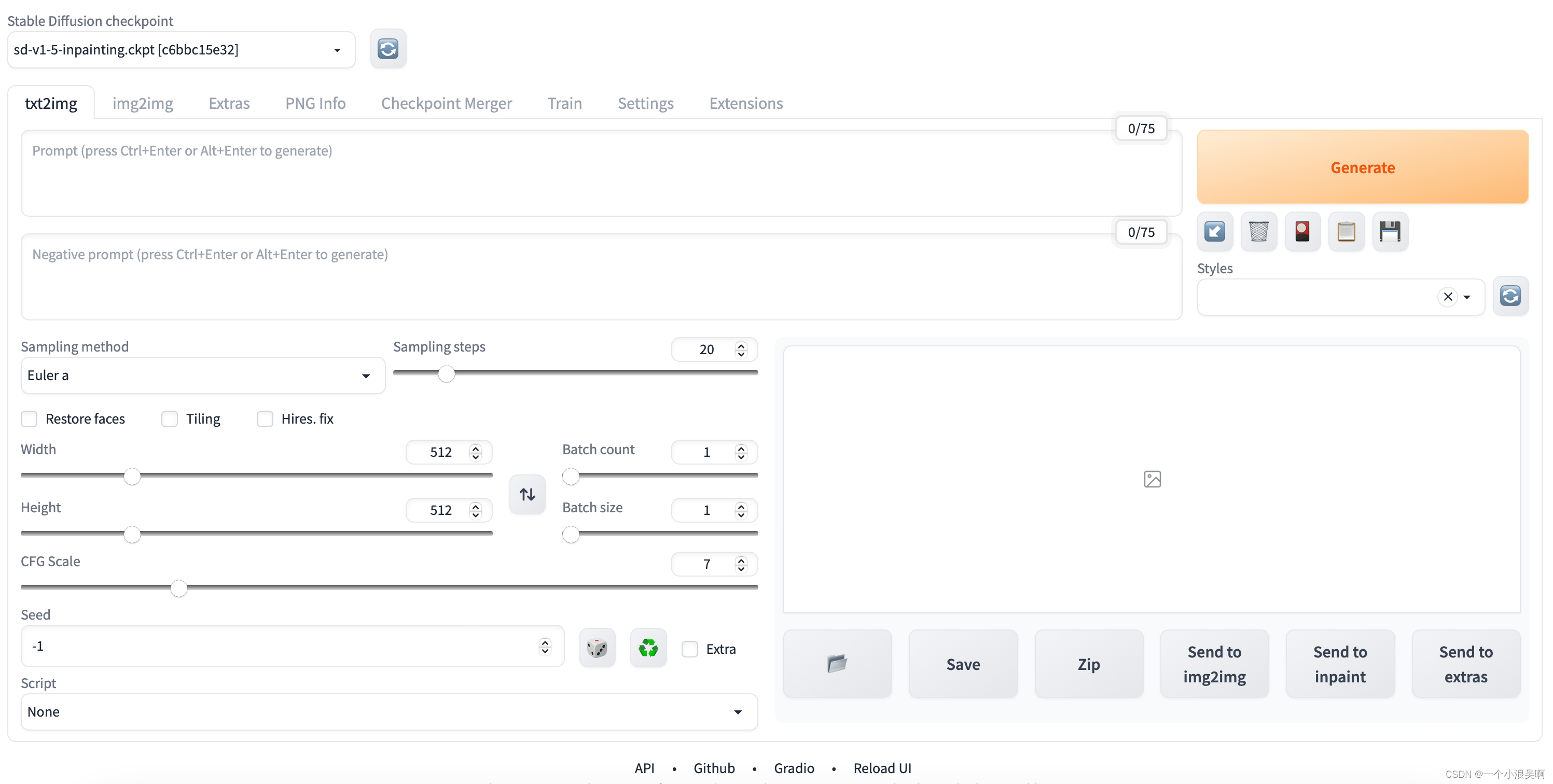

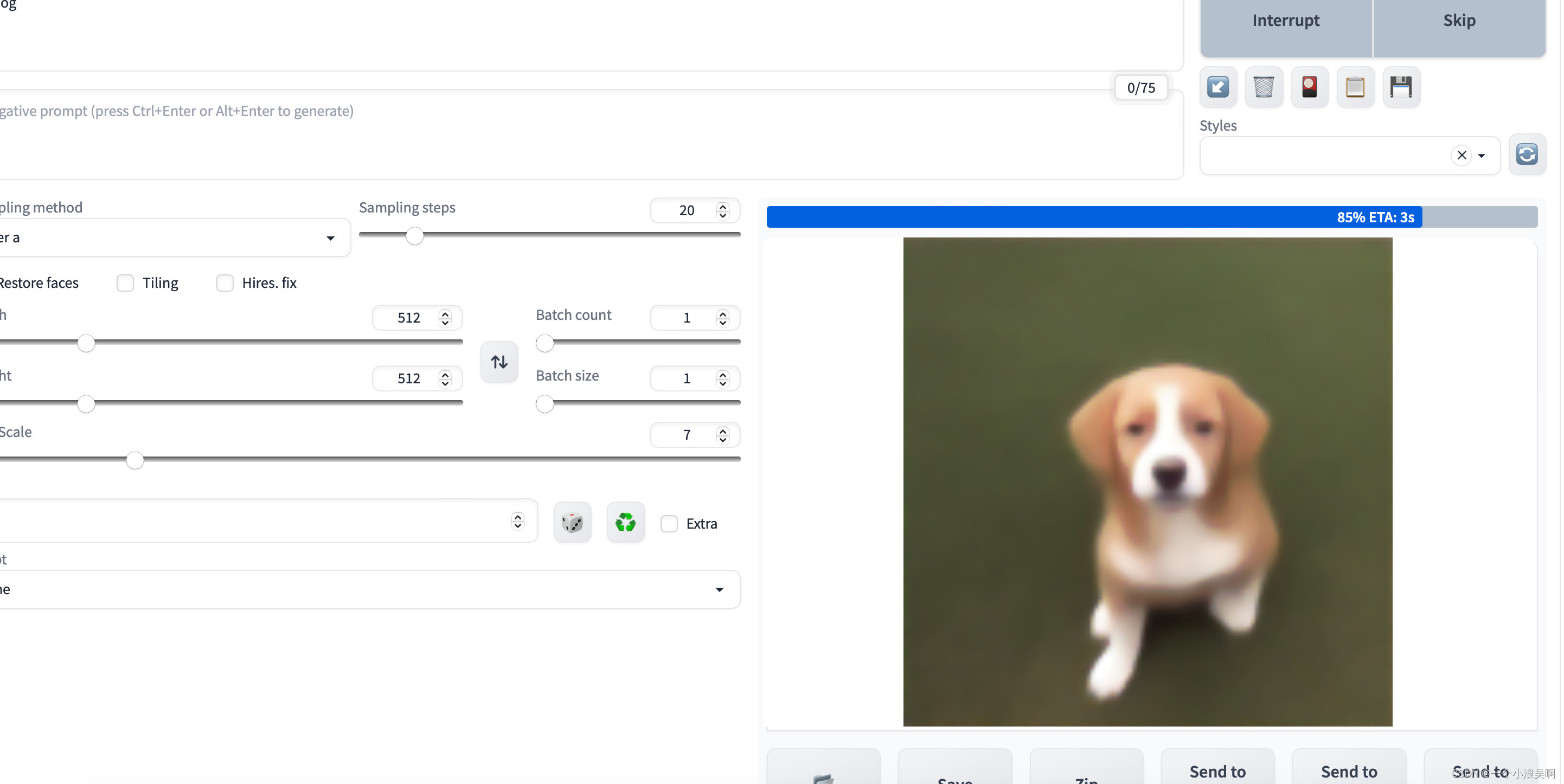

- 进入页面访问

自动安装

现有安装:

如果您有使用setup_mac.sh创建的现有Web UI安装,请从您的stable-diffusion-webui文件夹中删除run_webui_mac.sh文件和repositories文件夹。然后运行git pull来更新Web UI,然后./webui.sh来运行它。

下载稳定扩散模型

如果您没有任何模型可以使用,可以从Hugging Face下载稳定的扩散模型。要下载,请单击模型,然后单击Files and versions。查找列出带有“.ckpt”或“.safetensors”扩展名的文件,然后单击文件大小右侧的向下箭头进行下载。

一些流行的官方稳定扩散模型是:

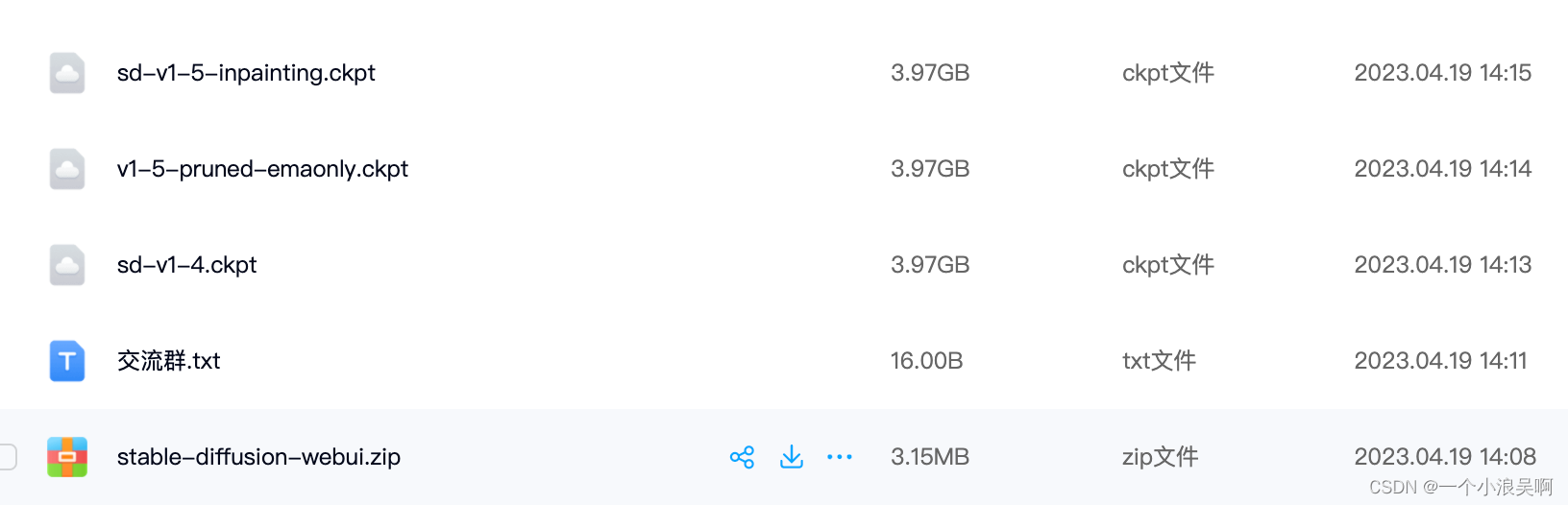

- 稳定的DIffusion 1.4(sd-v1-4.ckpt)

- 稳定扩散1.5(v1-5-pruned-emaonly.ckpt)

- 稳定扩散1.5 Inpainting(sd-v1-5-inpainting.ckpt)

稳定扩散2.0和2.1需要模型和配置文件,生成图像时,图像宽度和高度需要设置为768或更高:

对于配置文件,按住键盘上的选项键,然后单击此处下载v2-inference-v.yaml(可以下载为v2-inference-v.yaml.yml)。在Finder中选择该文件,然后转到菜单并选择File>Get Info。在出现的窗口中,选择文件名并将其更改为模型的文件名,但文件扩展名.yaml而不是.ckpt除外,在键盘上按return键(如果出现提示,请确认更改文件扩展名),并将其放在与模型相同的文件夹中(例如,如果您下载了768-v-ema.ckpt模型,请将其重命名为768-v-ema.yaml,并将其与模型一起放入stable-diffusion-webui/models/Stable-diffusion中)。

- 还提供稳定扩散2.0深度模型(512-depth-ema.ckpt)。通过按住键盘上的选项并单击此处下载

v2-midas-inference.yaml配置文件,然后以上述方式使用.yaml扩展名重命名,并将其与模型一起放入stable-diffusion-webui/models/Stable-diffusion。请注意,该模型在512宽度/高度或更高的图像尺寸下工作,而不是768。

故障排除

Web UI无法启动:

如果您在尝试使用./webui.sh启动Web UI时遇到错误,请尝试从stable-diffusion-webui文件夹中删除repositories和venv文件夹,然后在再次运行./webui.sh之前使用git pull更新Web UI。

性能不佳:

目前,macOS上的GPU加速使用了大量的内存。如果性能较差(如果使用任何采样器生成具有20个步骤的512x512图像需要超过一分钟),请先尝试从--opt-split-attention-v1命令行选项(即./webui.sh --opt-split-attention-v1开始,看看这是否有帮助。如果这没有太大区别,请打开位于/应用程序/实用工具中的活动监视器应用程序,并检查内存选项卡下的内存压力图。如果在生成图像时内存压力以红色显示,请关闭Web UI进程,然后添加--medvram命令行选项(即./webui.sh --opt-split-attention-v1 --medvram)。如果性能仍然很差,并且该选项的内存压力仍然为红色,那么请尝试--lowvram(即./webui.sh --opt-split-attention-v1 --lowvram)。如果使用任何采样器生成具有20步的512x512图像仍然需要几分钟以上,那么您可能需要关闭GPU加速。在Xcode中打开webui-user.sh,并将#export COMMANDLINE_ARGS=""更改为export COMMANDLINE_ARGS="--skip-torch-cuda-test --no-half --use-cpu all"。

来源地址:https://blog.csdn.net/A_yonga/article/details/130239041